Citazioni giurisprudenziali inesistenti, art. 96 c.p.c. e dovere di verifica del difensore

Nota a Tribunale di Siracusa, Sezione Seconda Civile, sentenza 20 febbraio 2026, n. 338, G.U. dott. Alfredo Spitaleri

di Stefano Oricchio

ABSTRACT

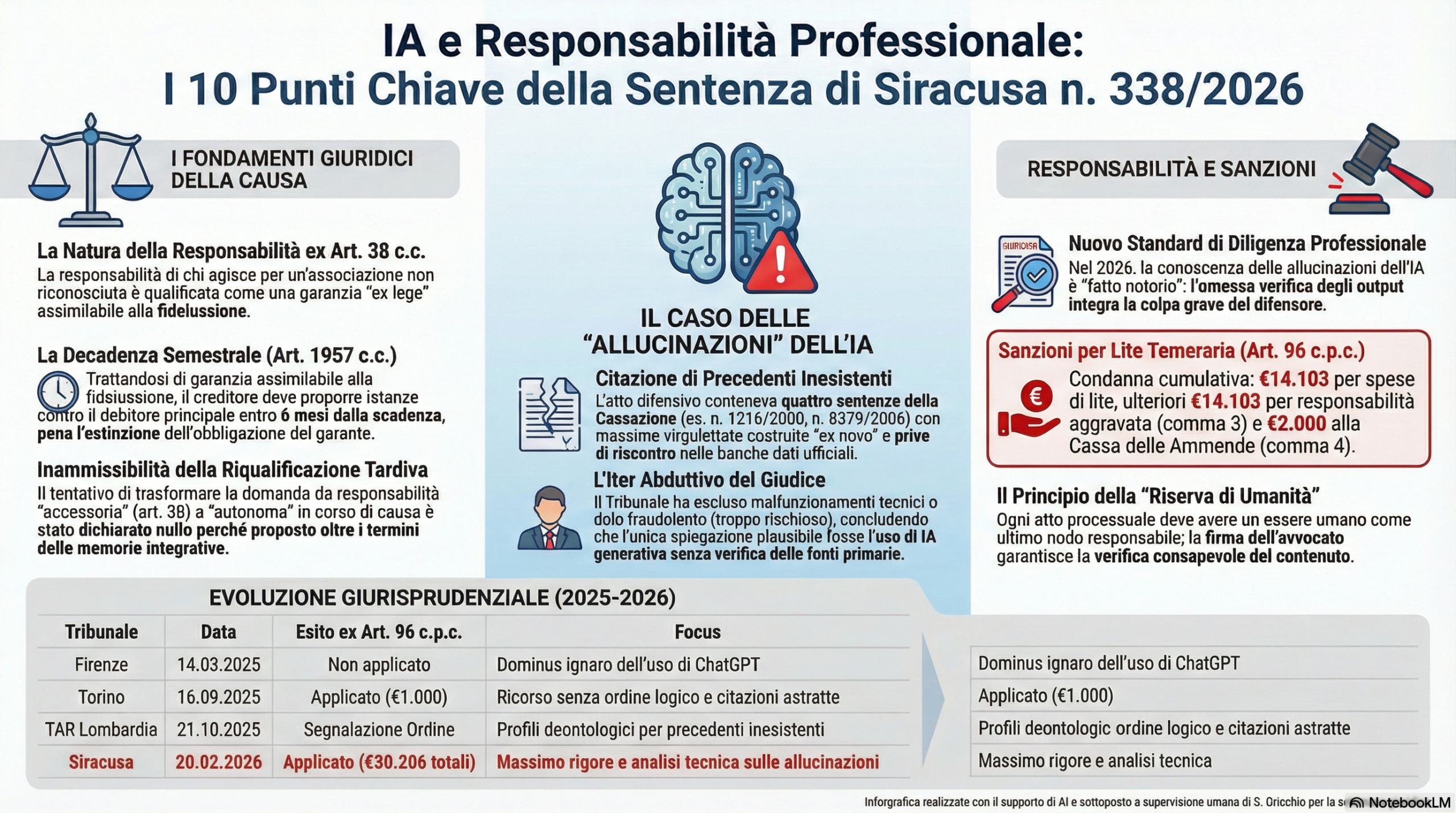

Il contributo esamina la sentenza del Tribunale di Siracusa n. 338/2026, tra le prime pronunce italiane che applica in forma cumulativa l’art. 96, commi 3 e 4, c.p.c. in un caso in cui il difensore ha prodotto, in sede di memoria difensiva, quattro massime virgolettate di sentenze della Corte di Cassazione integralmente inesistenti, la cui falsità è stata accertata dal giudice mediante consultazione diretta del CED della Suprema Corte. Il Tribunale, dopo aver sistematicamente escluso ogni ipotesi esplicativa alternativa — malfunzionamento delle banche dati, errore mnemonico, invenzione deliberata — perviene alla conclusione che l’unica spiegazione razionalmente sostenibile sia il ricorso acritico a strumenti di intelligenza artificiale generativa, senza verifica sulle fonti primarie. La pronuncia si inscrive in un filone giurisprudenziale in rapida evoluzione (Trib. Firenze marzo 2025; Trib. Torino e Latina settembre 2025; TAR Lombardia ottobre 2025) e ne costituisce il punto di maturazione più avanzato: non solo per l’entità della condanna (€ 14.103 ex art. 96, co. 3, oltre € 2.000 ex art. 96, co. 4) ma soprattutto per la elaborazione di un criterio ermeneutico che riconduce l’omessa verifica degli output dell’IA alla colpa grave, valorizzando la diffusa conoscenza del fenomeno delle c.d. “allucinazioni” quale standard di diligenza professionale ormai esigibile. Viene altresì esaminato il rapporto tra la sentenza e il principio della riserva di umanità, che – declinato nell’ambito della responsabilità forense – impone al difensore di mantenere il controllo critico sulla produzione algoritmica, esattamente come il diritto internazionale lo esige nell’ambito delle decisioni militari ad effetto letale. PAROLE CHIAVE

Intelligenza artificiale generativa · allucinazioni · Large Language Models · art. 96 c.p.c. · responsabilità aggravata · dovere di verifica · colpa grave del difensore · riserva di umanità

SOMMARIO

1. Incipit. – 2. Il fatto e la pronuncia. – 3. Il fenomeno delle allucinazioni dei modelli di linguaggio di grandi dimensioni. – 4. L’iter argomentativo del Tribunale di Siracusa: l’esclusione sistematica delle ipotesi alternative. – 5. L’art. 96, commi 3 e 4, c.p.c. come risposta ordinamentale all’abuso processuale. – 6. Il panorama giurisprudenziale precedente e il contributo evolutivo della sentenza in commento. – 7. La colpa grave del difensore e il dovere di verifica: verso uno standard professionale nell’uso dell’IA generativa. – 8. La riserva di umanità come principio trasversale: dal campo di battaglia all’aula di giustizia. – 9. Osservazioni conclusive.

Immaginate una memoria difensiva.

Quattro pagine, dodici paragrafi, un apparato di citazioni costruito con cura estrema cura. Virgolette aperte, numero di sentenza, sezione, data, anno. Virgolette chiuse.

Tutto perfetto. Tutto falso.

Le quattro sentenze richiamate non esistono. Non nel senso che sono di dubbia interpretazione, o che la massima è parziale, o che il difensore ha forzato il ragionamento del giudice. Nel senso letterale: quelle parole non sono mai state scritte da nessuna corte. Il CED della Corte di Cassazione non le conosce. Le banche dati giuridiche non le trovano. I virgolettati sono stati costruiti dal nulla — o meglio, da qualcosa di molto preciso: un modello di intelligenza artificiale generativa che, interrogato su una questione giuridica, ha risposto con la stessa sicurezza formale con cui avrebbe risposto a qualsiasi altra domanda. Compreso il numero di sentenza. Compresa la sezione. Compresa la data.

È questo il punto. Non che la macchina abbia sbagliato. La macchina non sbaglia e non dice la verità: genera. Produce sequenze di testo statisticamente plausibili. È quello che fa. Il problema non è la macchina — è che qualcuno si è fidato di lei senza controllare.

Il difensore che firma una memoria giudiziaria risponde di ogni parola che vi è contenuta. Non importa se quella parola l’ha scritta lui, un tirocinante, o un algoritmo. La firma è umana. La responsabilità è umana. Sempre.

La sentenza del Tribunale di Siracusa n. 338 del 20 febbraio 2026, pronunciata dal Giudice Unico dott. Alfredo Spitaleri, affronta questa vicenda con una precisione argomentativa che va ben oltre il caso di specie. Essa costruisce — per la prima volta in modo sistematico nell’ordinamento civile italiano — uno standard di diligenza professionale nell’impiego dell’intelligenza artificiale: uno standard che non vieta l’uso degli strumenti algoritmici, ma esige che l’uomo rimanga al comando. Non come opzione. Come obbligo.

Benvenuti nell’era in cui la responsabilità non si delega. Nemmeno alle macchine più intelligenti del mondo.

Il fatto e la pronuncia

Il giudizio di merito nasce da una domanda risarcitoria proposta da una società nei confronti del soggetto che aveva agito quale rappresentante di un’associazione non riconosciuta, in forza del meccanismo di responsabilità personale e solidale di cui all’art. 38 c.c. La controversia aveva già alle spalle un articolato contenzioso: una sentenza di appello della Corte d’Appello di Catania (n. 1970/2020) che aveva accertato la legittimità della risoluzione contrattuale per morosità, e un’ordinanza della Corte di Cassazione (n. 24819/2023) che aveva rigettato il ricorso avverso tale pronuncia, confermando la responsabilità solidale del convenuto in chiave fideiussoria ex art. 38 c.c.

Nel presente giudizio, l’attrice chiedeva il risarcimento di voci di danno non coperte dal giudicato precedente — lucro cessante per € 106.627,00 e indennità di avviamento per € 58.500,00 — che tuttavia il Tribunale ha ritenuto precluse dall’eccezione di decadenza ex art. 1957 c.c., stante la natura di garanzia ex lege assimilabile alla fideiussione propria della responsabilità ex art. 38 c.c., confermata dalla stessa ordinanza della Cassazione invocata dall’attrice a fondamento della propria pretesa.

Nel tentativo di superare l’eccezione di decadenza, l’attrice ha prodotto, nella memoria ex art. 171-ter, n. 1, c.p.c., quattro citazioni giurisprudenziali virgolettate, attribuite rispettivamente a Cass. n. 1216/2000, Cass. n. 8379/2006, Cass. n. 14795/2003 e Cass. n. 4553/2004, a sostegno della tesi dell’inapplicabilità dell’art. 1957 c.c. alla fattispecie dell’art. 38 c.c. e dell’assenza di litisconsorzio necessario. La difesa del convenuto ha prodotto i testi integrali delle pronunce indicate, dimostrando che i passaggi virgolettati non vi erano contenuti. Il Tribunale ha verificato autonomamente tale circostanza mediante il CED della Corte di Cassazione.

Evidenza probatoria: il Giudice ha effettuato la verifica in modo autonomo e d’ufficio tramite le banche dati della magistratura, senza fare esclusivo affidamento sulla produzione documentale del convenuto. La pronuncia sottolinea che «le sentenze richiamate o non risultano presenti, o risultano presenti ma con contenuto del tutto difforme dai passaggi virgolettati» (sent., pag. 13). Questo profilo assume rilievo metodologico: il controllo giurisdizionale d’ufficio dell’attendibilità delle citazioni si configura come strumento ordinario di presidio della fedeltà delle fonti nel processo.

Il fenomeno delle allucinazioni dei Large Language Models

I modelli di linguaggio di grandi dimensioni (Large Language Models, LLM) sono sistemi di intelligenza artificiale addestrati su corpus testuali di dimensioni massive — decine o centinaia di miliardi di parametri — mediante tecniche di apprendimento profondo. Il loro funzionamento non è assimilabile a quello di una banca dati: essi non “sanno” né “ricordano” nulla nel senso convenzionale del termine, ma producono output generando, token per token, la sequenza di testo statisticamente più probabile in relazione al contesto della query ricevuta.

Questa architettura genera quello che la letteratura scientifica definisce hallucination: la produzione di contenuti formalmente coerenti e stilisticamente plausibili che tuttavia non corrispondono ad alcuna realtà verificabile. Nel dominio giuridico, il fenomeno si manifesta nella generazione di citazioni giurisprudenziali dotate di tutti gli attributi formali di una pronuncia autentica — numero, sezione, data, massima virgolettata — ma prive di qualsiasi corrispondenza con il repertorio reale.

Come precisamente rilevato dal TAR Lombardia nella sentenza n. 3348/2025, «quando viene richiesta una citazione giurisprudenziale, l’LLM costruisce statisticamente una risposta plausibile sulla base dei pattern testuali del suo addestramento, senza accedere ad alcuna base di conoscenza verificata». Il modello non mente: non è in grado di distinguere il vero dal falso. Simula, con estrema competenza formale, la struttura di una massima giurisprudenziale.

Il fenomeno è noto. Non solo in dottrina. A partire dal 2023, negli Stati Uniti, si sono moltiplicati i casi di avvocati sanzionati per aver prodotto davanti a giudici federali citazioni generate da ChatGPT (il caso Mata v. Avianca del S.D.N.Y., 2023, è divenuto un caso di scuola).

In Italia, la giurisprudenza ha iniziato ad affrontarlo sistematicamente a partire dal marzo 2025. Il Tribunale di Siracusa, nel febbraio 2026, ne sancisce la classificazione come fatto notorio: «costituisce ormai fatto notorio, acquisito alla generalità dei consociati e certamente esigibile da un operatore professionale del diritto, che i modelli di intelligenza artificiale generativa non costituiscono banche dati giurisprudenziali» (sent., pag. 14).

Riferimenti tecnici: l’architettura transformer degli LLM (Vaswani et al., “Attention Is All You Need”, NeurIPS 2017) genera output attraverso meccanismi di attenzione che ponderano la probabilità condizionale di ciascun token in relazione al contesto. Nessun meccanismo interno distingue tra affermazioni vere e false; la coerenza sintattica e semantica non implica corrispondenza con la realtà. Ciò è noto a livello divulgativo sin dai primissimi dépliant di utilizzo di ChatGPT (novembre 2022). Il Tribunale di Siracusa ne trae la conseguenza di ritenere tale conoscenza “esigibile” da un avvocato nel 2026.

L’iter argomentativo del Tribunale: l’esclusione sistematica delle ipotesi alternative

La sentenza in commento si distingue per la qualità del ragionamento abduttivo adottato dal giudicante nell’individuare la causa delle citazioni inesistenti. Il Tribunale procede per exclusionem, esaminando sistematicamente tutte le ipotesi esplicative astrattamente configurabili:

- malfunzionamento delle banche dati giuridiche professionali: escluso, perché tali strumenti «indicizzano provvedimenti autentici e non generano testo, sicché non possono produrre precedenti con numeri, argomenti e virgolettati integralmente inesistenti» (sent., pag. 13);

- errore mnemonico o di trascrizione: escluso, perché «non si tratta di un numero errato o di una sezione male attribuita, bensì di massime costruite ex novo, prive di qualsiasi corrispondenza con le pronunce richiamate» (sent., pag. 13);

- invenzione deliberata: esclusa in quanto «un professionista del diritto che fabbricasse consapevolmente quattro precedenti inesistenti si esporrebbe a conseguenze disciplinari di estrema gravità, in una misura del tutto sproporzionata rispetto a qualsiasi vantaggio difensivo conseguibile» (sent., pag. 14). La plausibilità del dolo fraudolento è razionalmente esclusa in ragione della sproporzione tra rischio e beneficio.

Eliminati i tre scenari alternativi, il Tribunale perviene all’unica ipotesi residua: «il difensore si sia avvalso di uno strumento di intelligenza artificiale generativa senza sottoporre gli output ottenuti alla doverosa verifica sulle fonti primarie» (sent., pag. 14).

La solidità logica di questo iter è apprezzabile. Il ragionamento per exclusionem — noto anche come abduzione o “inferenza alla spiegazione migliore” (C.S. Peirce) — è metodologicamente corretto: in presenza di un fenomeno da spiegare, si elencano le ipotesi compatibili, si falsificano quelle empiricamente insostenibili, e si accede all’unica rimasta. La pronuncia non imputa all’attrice l’utilizzo di uno strumento di IA: imputa l’assenza di verifica successiva. È una distinzione di notevole rilievo pratico e dogmatico.

Non è l’uso dell’intelligenza artificiale a fondare la colpa grave. È l’omessa verifica dei suoi output mediante consultazione delle fonti primarie. Usare l’IA è legittimo. Fidarsi ciecamente di essa, nel 2026, non lo è più.

L’art. 96, commi 3 e 4, c.p.c. come risposta ordinamentale all’abuso processuale

La struttura della norma

L’art. 96 c.p.c. configura un sistema tripartito di responsabilità processuale aggravata. Il primo comma sanziona chi «ha agito o resistito in giudizio con mala fede o colpa grave» condannandolo al risarcimento del danno, previa prova dell’an e del quantum da parte del danneggiato. Il terzo comma — introdotto dalla l. n. 69/2009 — attribuisce al giudice il potere di condannare d’ufficio la parte soccombente al pagamento di una somma equitativamente determinata «anche in assenza della prova del danno». Il quarto comma — aggiunto dall’art. 3, co. 6, del D.lgs. n. 149/2022 (“Riforma Cartabia”) e applicabile ai procedimenti instaurati dopo il 28 febbraio 2023 — prevede, in aggiunta e d’ufficio, una condanna di importo compreso tra € 500,00 ed € 5.000,00 in favore della cassa delle ammende, con funzione di sanzione pubblicistica.

La sentenza in commento applica cumulativamente il comma 3 (€ 14.103,00 pari all’importo delle spese di lite, con interessi legali dalla pubblicazione) e il comma 4 (€ 2.000,00 a favore della cassa delle ammende), ritenendo la condotta dell’attrice integrativa di colpa grave se non di malafede. Il cumulo è rilevante: il legislatore della Riforma Cartabia ha inteso aggiungere una componente sanzionatoria ultra-compensativa, orientata non già al ristoro della controparte bensì alla deterrenza sistemica.

La qualificazione della condotta: colpa grave o malafede?

Il Tribunale si muove con cautela nell’inquadramento soggettivo. La formula utilizzata — «colpa grave, se non con mala fede» — lascia aperta la questione del dolo eventuale, senza risolverla. Ai fini applicativi dell’art. 96, co. 3, c.p.c. la distinzione non è dirimente, dato che la norma richiede «mala fede o colpa grave» in alternativa. Ciò che rileva, ai fini del presente commento, è la individuazione dei criteri che consentono di qualificare come gravemente colposa l’omessa verifica degli output dell’IA.

Il Tribunale elabora due argomenti. Il primo è la notorietà del fenomeno allucinatorio: un professionista del diritto che, nel 2026, ignori che i modelli di IA generativa sono soggetti ad allucinazioni «non adempie alla normale diligenza». Il secondo è la struttura stessa della condotta: i quattro precedenti non erano citati en passant, ma virgolettati come massime testuali, con indicazione di numero, sezione e data, a sostegno di una specifica eccezione processuale. La forma virgolettata, nella prassi redazionale forense, indica una citazione letterale verificata. Presentarla senza verifica equivale ad attestare l’autenticità di ciò che non è stato controllato.

Riferimento normativo: la Legge 23 settembre 2025, n. 132, “Disposizioni e deleghe al Governo in materia di intelligenza artificiale” (in vigore dal 10 ottobre 2025), pur non disciplinando espressamente l’uso dell’IA in ambito forense, fissa all’art. 3 il principio di supervisione umana (human oversight) come requisito generale per l’impiego di sistemi di IA ad alto rischio. L’impiego di LLM nella redazione di atti giudiziari — atti che incidono direttamente su diritti fondamentali e sull’equilibrio del processo — rientra agevolmente in tale categoria.

Il panorama giurisprudenziale e il contributo evolutivo della sentenza in commento

La sentenza del Tribunale di Siracusa si innesta in un filone giurisprudenziale che, nel giro di meno di un anno, ha conosciuto un’evoluzione significativa. La tabella che segue ne riassume le tappe principali, evidenziando le variabili rilevanti ai fini della comprensione del contributo evolutivo della pronuncia in commento.

| Tribunale | Condotta contestata | Esito ex art. 96 c.p.c. | Elemento chiave |

| Firenze, Sez. Imprese, 14.3.2025 | Citazioni generate da ChatGPT, estratte da collaboratrice di studio senza controllo del dominus | Art. 96 c.p.c. non applicato: assenza di colpa grave del dominus (ignorava l’utilizzo del tool) | Mancanza di prova del danno specifico; citazioni a mero rafforzamento di tesi già delineata |

| Trib. Torino, Sez. Lavoro, 16.9.2025, n. 2120 | Ricorso redatto col supporto dell’IA: citazioni astratte e inconferenti, privo di ordine logico | Art. 96, co. 3 e 4 applicato: € 500 per parte + € 500 cassa ammende per malafede/colpa grave | Atto qualificato come abuso dello strumento processuale; impatto diretto sulla decisione |

| Trib. Latina, 23.9.2025, n. 1037 | Uso di IA nella redazione: citazioni inesistenti come supporto difensivo | Art. 96, co. 3 applicato: condanna per colpa grave | Allineamento con orientamento Torino; consolidamento del filone sanzionatorio |

| TAR Lombardia, Sez. V, 21.10.2025, n. 3348 | Precedenti inesistenti e non pertinenti (urbanistica, volo sportivo) citati in causa scolastica | Trasmissione atti all’Ordine Avvocati Milano ex art. 50, co. 4, L. 247/2012: profilo deontologico | Prima pronuncia in ambito amministrativo; baricentro spostato da responsabilità processuale a deontologica |

| Trib. Siracusa, Sez. II Civile, 20.2.2026, n. 338 | Quattro massime virgolettate inesistenti citate su banche dati ufficiali verificate dal giudice ex officio | Art. 96, co. 3: € 14.103 + interessi legali; art. 96, co. 4: € 2.000 cassa ammende | Analisi esaustiva delle ipotesi esplicative; colpa grave per omessa verifica delle fonti primarie; notorietà del fenomeno allucinatorio |

Tab. 1 – Evoluzione della giurisprudenza italiana sull’uso dell’IA generativa negli atti difensivi (2025–2026)

Il confronto tra le pronunce evidenzia una progressione nel rigore sanzionatorio: si è passati dall’esclusione dell’art. 96 c.p.c. (Firenze, marzo 2025, ove mancava la prova del danno specifico e il dominus non era a conoscenza dell’uso dell’IA da parte della collaboratrice) all’applicazione cumulativa dei commi 3 e 4 con importi prossimi al massimo (Siracusa, febbraio 2026).

Il salto qualitativo della sentenza siracusana rispetto ai precedenti è duplice.

Sul piano probatorio, la pronuncia valorizza la verifica d’ufficio del giudice come strumento ordinario di accertamento della falsità delle citazioni, senza limitarsi alla documentazione prodotta dalle parti.

Sul piano dogmatico, eleva la conoscenza del fenomeno allucinatorio a standard di diligenza esigibile da qualsiasi operatore professionale del diritto nel 2026, trasformando l’ignorantia del difensore da attenuante a elemento costitutivo della colpa grave.

La colpa grave del difensore e il dovere di verifica: verso uno standard professionale

L’impatto più rilevante della sentenza in commento è l’elaborazione implicita di uno standard professionale nell’uso dell’IA generativa. Tale standard non è formulato come regola esplicita — il giudice non codifica un obbligo de iure condendo — ma emerge come postulato logico dal ragionamento svolto: chi usa l’IA per la ricerca giurisprudenziale ha il dovere di verificare ogni citazione mediante consultazione delle fonti primarie (CED, banche dati ufficiali, repertori autentici) prima di inserirla in un atto processuale con virgolette.

Questo standard trova una puntuale corrispondenza in diversi strumenti di autoregolamentazione professionale. La «Carta dei principi per un uso consapevole dei sistemi di intelligenza artificiale in ambito forense» elaborata dall’Ordine degli Avvocati di Milano nel 2024 (c.d. Carta HOROS) afferma la «centralità della decisione umana» e impone al difensore «l’onere di verifica e controllo dell’esito delle ricerche effettuate con i sistemi di intelligenza artificiale, possibile fonte di risultati erronei comunemente denominati allucinazioni di intelligenza artificiale». Le Linee Guida del CCBE (Consiglio degli Ordini forensi europei) sull’uso dell’IA generativa da parte degli avvocati (ottobre 2025) ribadiscono l’obbligo di mantenere la competenza professionale attraverso la verifica degli output. Il CSM, con le indicazioni del 2025, ha affermato che la responsabilità resta confinata alla sfera umana di chi firma l’atto, «indipendentemente dalla circostanza che questi li abbia redatti personalmente o avvalendosi dell’attività di propri collaboratori o di strumenti di intelligenza artificiale» (cfr. TAR Lombardia n. 3348/2025, in motivazione).

Il quadro che emerge è coerente: l’uso dell’IA come strumento di ricerca o di drafting non è proibito, né di per sé stigmatizzato. È richiesta, semplicemente, la stessa diligenza professionale che si esige per qualsiasi altro strumento di lavoro. Con una differenza fondamentale: gli strumenti tradizionali (banche dati, repertori, massimari) non generano — si limitano a indicizzare e restituire. L’IA generativa produce. E ciò che produce può essere falso.

La riserva di umanità: dal campo di battaglia all’aula di giustizia

Il principio della riserva di umanità — meglio noto nella letteratura internazionalistica come meaningful human control — nasce nel diritto internazionale umanitario come risposta all’emersione dei sistemi d’arma letali autonomi (LAWS). Esso afferma che le decisioni che producono effetti letali — la selezione e l’ingaggio di un bersaglio — devono restare sotto il controllo effettivo, consapevole e responsabile di un essere umano. Non perché le macchine siano meno precise. Ma perché la responsabilità giuridica e morale non può essere trasferita a un algoritmo.

La Strategia della Difesa italiana in materia di Intelligenza Artificiale (Edizione 2026) assume questo principio come cardine dottrinale irrinunciabile, indicando nel «mantenimento del controllo umano e nella responsabilità permanente della catena di comando» un criterio fondamentale nell’impiego dell’IA in ambito militare. È una scelta che si colloca deliberatamente all’opposto di quella impressa dall’amministrazione Trump al proprio apparato di difesa, il quale — prima di accettare con OpenAI clausole sostanzialmente equivalenti a quelle che aveva rifiutato ad Anthropic — aveva richiesto la rimozione dei guardrail su armi autonome e sorveglianza di massa, generando quella frattura pubblicamente nota con il ban di Anthropic del 27 febbraio 2026.

La sentenza del Tribunale di Siracusa non parla di missili né di droni. Parla di una memoria difensiva. Eppure applica la medesima struttura logica: una decisione — l’inserimento di una citazione giurisprudenziale in un atto processuale — non può essere delegata in toto alla macchina. Deve passare per il controllo critico di un essere umano. Il difensore che firma l’atto è il «decision maker» che il diritto internazionale umanitario colloca al centro della catena di comando: colui che risponde di ogni conseguenza.

La riserva di umanità non è un principio etico astratto. È un meccanismo di imputazione della responsabilità. Vale per chi decide di bombardare. Vale per chi decide quale massima inserire in una memoria. Il livello cambia. La struttura logica no.

In questa prospettiva, la sentenza siracusana offre un contributo al dibattito teorico più ampio sul rapporto tra decisione algoritmica e responsabilità giuridica. Il problema non è l’IA — la sua utilità nel settore legale è fuori discussione. Il problema è la catena di responsabilità: ogni atto processuale che produce effetti giuridici deve avere, al suo ultimo nodo, un essere umano consapevole e verificante. Questo è il principio. E il giudice di Siracusa lo ha applicato con conseguenze pecuniarie concrete.

Osservazioni conclusive

La sentenza del Tribunale di Siracusa n. 338/2026 costituisce un arrêt de principe nell’evoluzione della giurisprudenza italiana sull’uso dell’intelligenza artificiale generativa in ambito processuale. Essa stabilisce almeno tre principi di diretta rilevanza pratica e dogmatica.

Il primo principio: la conoscenza del fenomeno delle allucinazioni degli LLM è, nel 2026, un fatto notorio esigibile da qualsiasi professionista del diritto. L’ignoranza di tale fenomeno non è un’attenuante, ma un indicatore di colpa grave. Lo standard di diligenza professionale comprende la verifica degli output algoritmici mediante consultazione delle fonti primarie.

Il secondo principio: l’uso acritico dell’IA generativa nella redazione di atti processuali — inteso come utilizzo degli output senza verifica sulle banche dati ufficiali — integra la fattispecie dell’art. 96, co. 3, c.p.c. Ciò non riguarda l’uso dell’IA in quanto tale, ma specificamente l’omessa verifica. Il discrimine è netto: l’IA come strumento ausiliario e verificato è legittimo; l’IA come fonte autonoma e non verificata è processualmente censurabile.

Il terzo principio: la responsabilità per la falsità delle citazioni incombe sul difensore che firma l’atto, indipendentemente da chi — collaboratore, tirocinante, algoritmo — abbia materialmente prodotto il testo. La firma è il punto di imputazione della responsabilità. È la riserva di umanità applicata al processo.

Restano aperte alcune questioni di sistema. In primo luogo, la disciplina della responsabilità deontologica: la trasmissione degli atti all’Ordine professionale — scelta operata dal TAR Lombardia n. 3348/2025 ma non dalla sentenza di Siracusa — potrebbe configurare uno strumento complementare alla responsabilità processuale aggravata, con effetti anche sull’obbligo assicurativo. In secondo luogo, l’evoluzione normativa: la Legge n. 132/2025 sull’IA pone le basi per una regolamentazione più specifica dell’uso professionale degli LLM, che potrebbe includere obblighi espliciti di verifica negli atti che incidono su diritti fondamentali. In terzo luogo, il confine del sindacato giudiziale: la verifica d’ufficio delle citazioni — praticata dal Tribunale di Siracusa — è un esercizio dei poteri ufficiosi del giudice che potrebbe, se sistematizzata, ridisegnare il perimetro dell’istruzione e del contradittorio nel processo civile.

Una cosa è certa. Il futuro del processo civile nell’era dell’IA generativa passerà, inevitabilmente, per la riaffermazione di un principio antico quanto il diritto romano: nemo plus iuris ad alium transferre potest quam ipse habet. Nessuno può trasferire più diritti di quanti ne abbia. E nessun difensore può trasferire la propria responsabilità a una macchina che non conosce la differenza tra il vero e il falso.

NOTE E RIFERIMENTI NORMATIVI ESSENZIALI

Art. 96, co. 3, c.p.c. Inserito dalla L. 18 giugno 2009, n. 69, art. 45, co. 12. Consente la condanna d’ufficio della parte soccombente al pagamento di una somma equitativa, anche in assenza di domanda e di prova del danno, quando il giudice rilevi la propria responsabilità per aver agito o resistito con mala fede o colpa grave.

Art. 96, co. 4, c.p.c. Aggiunto dall’art. 3, co. 6, D.lgs. 10 ottobre 2022, n. 149 (Riforma Cartabia). Prevede una condanna ulteriore a favore della cassa delle ammende, da € 500 a € 5.000, applicabile ai procedimenti instaurati dopo il 28 febbraio 2023.

Art. 38 c.c. Disciplina la responsabilità personale e solidale di chi agisce in nome e per conto di un’associazione non riconosciuta. Per costante orientamento di legittimità, tale responsabilità è inquadrabile tra le garanzie ex lege assimilabili alla fideiussione, con conseguente applicazione dell’art. 1957 c.c. (termine di decadenza semestrale).

Art. 1957 c.c. Fissa il termine semestrale di decadenza per il fideiussore dal momento in cui il debito principale è esigibile, salvo che il creditore abbia proposto domanda nei confronti del debitore principale entro tale termine. La pronuncia in commento applica tale termine alla responsabilità ex art. 38 c.c., in conformità a Cass. n. 27163/2025.

23 settembre 2025, n. 132. “Disposizioni e deleghe al Governo in materia di intelligenza artificiale”, in vigore dal 10 ottobre 2025. Fissa principi di supervisione umana, trasparenza e responsabilità nell’uso di sistemi di IA. Rilevante per l’inquadramento dello standard di diligenza professionale nell’uso degli LLM.

Carta HOROS (2024). “Carta dei principi per un uso consapevole dei sistemi di intelligenza artificiale in ambito forense”, elaborata dall’Ordine degli Avvocati di Milano. Afferma la centralità della decisione umana e il dovere di verifica degli output dell’IA.

CCBE Guidelines (ottobre 2025). Linee Guida del Consiglio degli Ordini forensi europei sull’uso dell’IA generativa da parte degli avvocati. Sottolineano il rischio delle allucinazioni e l’obbligo di mantenere la competenza professionale nella verifica degli output.

Trib. Siracusa, Sez. II Civile, 20.2.2026, n. 338, G.U. dott. Alfredo Spitaleri, r.g. 1244/2025. La sentenza è inedita alla data di redazione del presente contributo.

Slide Esplicative